Um sobre Zero #50

Olá, eu sou o António Lopes e esta é a newsletter do Um sobre Zero, um podcast sobre o futuro da ciência e tecnologia.

Para entrar no fim de semana de bom humor

Nos anos em que eu ensinava Algoritmos e Estruturas de Dados, os estudantes nunca percebiam muito bem a analogia das árvores binárias. O jeitinho que esta imagem me tinha dado nessa altura.

Anteriormente... no Um sobre Zero

As temáticas que abordo hoje na newsletter tornam ainda mais relevante o episódio 65 do Um sobre Zero. Neste episódio, eu interagi com o modelo de geração de linguagem GPT-3 para me ajudar a construir o texto do episódio. Vale a pena ouvirem, quanto mais não seja para perceberem que isto não é a verdadeira inteligência artificial (generalizada).

Não, o LaMDA não é autoconsciente

Um engenheiro que lida com questões de ética na Google decidiu recentemente criar uma polémica com as suas declarações de que um modelo artificial de geração de linguagem da Google, o LaMDA, se tornou autoconsciente. Eu não sei se ele fez isto por sede de protagonismo ou se é simplesmente ingénuo demais e não percebe como estes modelos funcionam, mas custa-me a acreditar que alguém com a experiência para trabalhar nesta área, cairia na esparrela de assumir que, lá porque um modelo deste género consegue criar respostas inteligíveis no contexto de uma conversa, o mesmo se tenha self-aware. Aliás, basta ouvirem o episódio 65 do Um sobre Zero, em que eu “falei” com o GPT-3, para perceberem bem como estes modelos funcionam e como não são propriamente autoconscientes.

A questão é que as conversas que ele teve com o modelo são conversas muito debatidas na internet, nos imensos fóruns de discussão que existem nesta rede. E são exatamente essas conversas nesses fóruns (para além de outras fontes) que fizeram parte dos textos que alimentaram a construção deste modelo. O que significa que o modelo aprendeu muito bem o que responder nas circunstâncias em que a conversa se vira para áreas como “as inteligências artificiais serão as nossas escravas?”.

O que esse engenheiro não foi capaz de perceber é o que as respostas que o modelo deu são apenas o resultado desse treino intensivo com milhões e milhões de textos que se traduz nesta miragem de uma pessoa a falar. E, a vontade do querer sobrepôs-se à realidade do ser… se calhar, ele foi mais uma vítima do efeito Eliza.

Há uma thought experiment conhecida como o Quarto Chinês que pode ser uma boa forma de se colocarem nesta posição. Vou sugerir aqui uma adaptação dessa experiência. Imaginem que estão fechados numa sala que tem uma pequena janela por onde entram uns papéis com texto em chinês. A vossa tarefa é receber esses papéis e para cada um deles, consultar um livro gigante que está à vossa frente que tem uma tabela com todas as perguntas possíveis de virem nesses papéis que recebem, com as respetivas respostas, também em Chinês, e escrever as respostas correspondentes nos papéis e devolver pela janela. Para uma pessoa que até fala Chinês que esteja fora da sala e esteja a fazer as perguntas e a receber as respostas, a pessoa que está dentro da sala é alguém fluente em Chinês. Mas vocês sabem muito bem que esse não é o caso (estou a assumir que vocês não são fluentes em Chinês).

O que se passa com o LaMDA é algo semelhante. É um modelo que foi construído de forma a deter essa quantidade enorme de informação linguística estruturada ao ponto de parecer que é um ser autoconsciente capaz de ter uma conversa séria com um humano. Mas, não, o LaMDA não é autoconsciente. Contudo pode ser meio caminho andado para criarmos as primeiras IAs que efetivamente são capazes de mimetizar o estilo de conversação humano ao ponto de ser impossível de distinguir de uma pessoa. E mesmo que chegue a esse ponto, não quer dizer que seja autoconsciente. Só quer dizer que aperfeiçoou de tal forma o seu “quarto chinês” ao ponto de completar a ilusão.

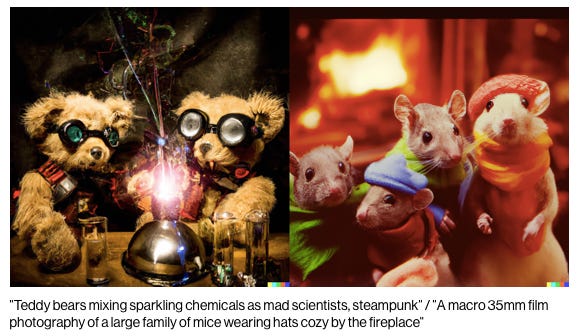

Imagen, DALL-E e a IA da geração de imagens

Como tinha referido na última edição da newsletter, a Google criou o Imagen, um modelo de inteligência artificial capaz de processar um texto de língua natural e produzir uma imagem correspondente. Apesar de ainda não estar disponível ao público em geral, já se prevê que vai conseguir destronar o extraordinário DALL-E da OpenAI.

Mais uma vez, a existência destes modelos geram uma conversa muito importante sobre o que significa criar este tipo de sistemas que começam a mimetizar comportamentos até agora exclusivamente humanos. Quem já experimentou o DALL-E sabe muito bem a sensação que é de estar a trabalhar com algo quase mágico. Seja o que for que imaginem, o modelo é capaz de gerar (ainda que nalguns casos de forma algo rústica).

Testemunhar este tipo de avanço tecnológico faz-nos sentir que estamos a viver no futuro e sabemos bem que vão deixar um impacto duradouro. Ainda que neste momento não passe de uma ferramenta quase de brincadeira, a verdade é que isto tem um potencial enorme para ser completamente disruptivo para a indústria criativa.

Mas ao mesmo tempo levanta questões pelo meio:

Outras notícias

O Elon Musk desejou, o Twitter entregou. Pois é, o Twitter criou uma nova forma de publicar textos longos. 2005 telefonou e pediu os seus blogs de volta!

Mecanismos de autenticação por via de cartões Smart ID até é uma boa prática, mas convém verificar se o leitor que compram não vem com malware.

Ainda no tópico de modelos de geração de linguagem, este é o resultado de treinar um modelo com origem em textos do 4Chan.

Spotify continua na sua missão de dominar o mundo do áudio, desta feita, com a aquisição de uma startup especializada em text-to-speech. Cheira-me que vão usar isto para geração de podcasts automáticas.

O facto da Apple ter decidido suportar todo o sistema de crédito para o seu recém anunciado sistema de pagamento Buy-Now, Pay-Later sem recorrer a um parceiro financeiro, reflete bem a verticalização que eles conseguiram atingir no mercado. Com a quantidade incrível de informação que têm sobre as pessoas que usam os seus dispositivos (e com a consequente incrível quantidade de dinheiro que geram com isso), eles não precisam de mais ninguém para decidir a quem podem ou não ceder este tipo de crédito sem juros.

A ex-funcionária e delatora dos comportamentos inaceitáveis do Facebook, Frances Haugen, conseguiu angariar o dinheiro necessário para criar uma fundação que terá como um dos objetivos construir uma rede social simuladapara que reguladores, académicos e outros possam fazer uma espécie de “jogos de guerra” em cenários potenciais e tenham a oportunidade de entender como essas plataformas operam sem ter que recorrer aos dados das empresas reais (que se fazem difíceis para fornecer).

Recomendações de podcasts para o fim de semana

Cautionary Tales - Frankestein versus the volcano

Eu não me canso de recomendar o podcast Cautionary Tales. E este episódio é mais um exemplo de como o Tim Harford (e equipa) consegue relacionar histórias de tragédias, acidentes e falhanços num brilhante exercício de aprendizagem.

Brevemente... no Um sobre Zero

Sei que tenho falhado na publicação de novos episódios, mas entre lidar com COVID, constipações, excesso de trabalho e outras coisas que tais, tem sido muito complicado conseguir produzir os episódios. Mas eles virão.

Nota final

Se quiserem experimentar uma espécie do DALL-E, podem sempre experimentar esta versão mais simples e aberta ao público.

Bom fim de semana