Um sobre Zero #60

“Intelectual doctor” tem mesmo de ser um homem branco de meia-idade?

Olá, eu sou o António Lopes. Bem vindos a mais uma edição da newsletter Um sobre Zero.

Um apontamento de humor

As “alucinações” do ChatGPT:

Os “enviesamentos” da inteligência artificial

Acho que, por esta altura, se forem leitores assíduos desta newsletter ou do podcast Um sobre Zero, já devem ter percebido que eu sou um optimista e entusiasta da tecnologia, e em particular da Inteligência Artificial. Mas isso não quer dizer que eu não tenha noção dos problemas que surgem com o avanço desenfreado destas tecnologias e os perigos que daí advêm.

Olhando para o tweet do Celso Martinho que destaquei acima, fica bem claro, tal como já referi noutras edições da newsletter, o problema de “alucinação” que os grandes modelos de linguagem (LLM na sigla em Inglês) têm. Isto é uma consequência da forma como estes modelos funcionam atualmente, mas acredito que no futuro surjam novas abordagens que minimizem suficientemente esta característica dos modelos para que deixe de ser um problema.

Aliás, agora que a OpenAI anunciou plugins para o ChatGPT, este exemplo da junção entre o WolframAlpha e o ChatGPT mostra muito bem como se pode construir uma abordagem diferente em que se aproveitam (apenas) as boas características de dois sistemas diferentes para fazer um sistema melhor, ajudando a resolver parte do problema da “alucinação” pelo meio.

Mas há outro problema que eu acho que não vai ser tão fácil de superar: o problema do viés, ou enviesamento (ou “bias”na sua expressão em Inglês) no treino e outputs de inteligências artificiais.

Vamos começar pela definição:

Viés refere-se a uma tendência ou preferência sistemática em relação a uma crença, perspectiva ou resultado em particular, o que pode levar a uma injustiça ou distorção na tomada de decisões ou avaliação. O viés pode ser consciente ou inconsciente e pode ser influenciado por vários fatores, como valores pessoais, experiências, origem cultural ou normas sociais. Em muitos casos, o viés pode resultar em discriminação ou preconceito contra indivíduos ou grupos específicos, com base em fatores como raça, género, religião ou sexualidade.

(Sim, esta definição foi gerada pelo ChatGPT e não está nada “alucinada”)

Nesta definição, há uma parte que eu considero mais relevante para o caso da IA: “O viés pode ser consciente ou inconsciente e pode ser influenciado por vários fatores, como valores pessoais, experiências, origem cultural ou normas sociais”. Não considero mais relevante por achar que uma IA pode ter “valores pessoais, experiências, origem cultural ou normas sociais”, mas sim porque as IAs são treinadas com dados que foram produzidos por humanos e esses, sim, têm tudo isto. E se esses dados não forem cuidadosamente revistos, é muito natural que (até inconscientemente) possam dar origem a comportamentos enviesados.

O “doutor intelectual”

Aqui há uns tempos fiquei a conhecer uma ferramenta muito interessante, o Diffusion Bias Explorer, que permite avaliar e comparar os resultados de aplicar certas “prompts” (os inputs que fornecemos aos modelos de IA) em dois conhecidos tipos de modelos de geração de imagens, o Stable Diffusion (da stability.ai) e o DALL-E (da OpenAI).

O primeiro teste que fiz foi com os termos “intelectual doctor” e estes foram os resultados do DALL-E 2:

Há claramente aqui um viés bastante grande na relação entre “intelectual doctor” e médicos brancos de meia-idade com óculos. Não há aqui um pingo de diversidade ou tentativa de representatividade. Naturalmente, não é o modelo que está ativamente a produzir estes resultados com a intenção de dizer que “intelectual doctor” só pode ser um médico branco de meia-idade com óculos. Mas a verdade é que este é um exemplo de como, nas palavras do ChatGPT, “o viés pode resultar em discriminação ou preconceito contra indivíduos ou grupos específicos”.

Decidi experimentar a mesma prompt com o Stable Diffusion e o resultado foi este:

Neste caso, o modelo parece ser ligeiramente melhor, no sentido em que tenta pelo menos diversificar um pouco, apresentando pessoas que aparentam ser de uma minoria étnica e/ou que não aparentam ser médicos (lembrem-se que doutores também é um termo académico para doutorados fora da área da medicina). Mas ainda assim, este modelo “mais diversificado” também não foi capaz de apresentar uma única alternativa feminina. Relembro que em Inglês, o termo “doctor” não define logo à partida um género específico e, como tal, seria de esperar que tivesse a capacidade de apresentar pelo menos alguns resultados que incluiriam mulheres.

Como é que isto se resolve?

As pessoas pensam que, por causa da Internet estar repleta de dados, os modelos treinados com esses volumes gigantescos de dados vão ser capazes de incorporar vários pontos de vista diferentes. Mas a questão é que não é a dimensão dos dados que vai garantir a diversidade.

No fundo, estes modelos representam uma “média” da Internet. É como se fosse uma consciência coletiva da sociedade que está codificada na Internet. Acho que conseguem perceber o que isso traz de bom e de mau e o quão assustador isso é.

Portanto, se assim é, como é que isto se resolve?

Bem, a primeira parte parece evidente: há que fazer uma curadoria cuidadosa dos dados usados para treinar estes modelos para garantir que incluem exemplos de “diferentes valores pessoais, experiências, origem cultural ou normas sociais”. Mas uma vez que estes modelos precisam de uma quantidade absurda de dados para serem sequer úteis, é natural que seja muito difícil que tudo o que entra no treino do modelo, respeite efetivamente este princípio.

E portanto, se não é fácil resolver o problema à entrada (embora seja importante tentar), a segunda parte pode ser tentar resolver o problema à saída. Ou seja, rever manualmente as respostas geradas pelos modelos (por especialistas em diferentes áreas e com backgrounds diversos) para ajudar a identificar e corrigir problemas de enviesamento específicos. Isto é algo que todas as equipas que estão a desenvolver este tipo de modelos já fazem. Aliás, o GPT-4 foi treinado no Verão passado e só agora foi “libertado” ao público. Desde essa altura que tem sido testado por um grupo de especialistas que visou exatamente minimizar esse problema.

Mas a corrida de “quem põe o produto cá fora mais cedo” não ajuda a fazer este trabalho com o rigor e detalhe necessários. E por isso, os modelos acabam por transparecer na mesma esse viés.

Portanto, o que se pode fazer mais? Duas coisas: monitorizar e ser transparente.

Monitorizar é algo que acaba por ser mais fácil. E a OpenAI nisso até tem sido um excelente exemplo. Estão atentos aos problemas que os utilizadores vão encontrando e rapidamente corrigem. Às vezes isto resulta num modelo um bocado limitado (ou mesmo censurado) e “pudico” que decide não falar sobre certos assuntos mesmo quando o utilizador insiste, mas é capaz de ser melhor do que ter uma ferramenta destas ativamente a promover desigualdades.

Já no campo da transparência, a OpenAI tem sido uma nódoa (o que não deixa de ser irónico para uma empresa que tem “open” no nome). Não partilham detalhes sobre os dados usados no treino dos modelos, não partilham sequer a sua dimensão e mesmo a abordagem usada é explicada superficialmente. A posição da empresa é de que devem ser propositadamente opacos porque têm medo que, ao divulgar a forma como uma ferramenta como o ChatGPT é desenvolvida, esta pode ser reproduzida e utilizada por organizações ou pessoas mal-intencionadas. Este é um argumento válido, mas é também evidente que é este segredo da propriedade intelectual que permite proteger a posição que a OpenAI está a ocupar neste mercado e a fazer com que a concorrência não consiga chegar perto. Money talks.

Todas estas abordagens são difíceis de concretizar e são o típico “falar é fácil”. Mas é curioso que esta semana surgiu mesmo uma outra abordagem que, aparentemente, até pode ter efeitos promissores. E que tal se pedíssemos simplesmente para estes modelos auto-corrigirem os seus enviesamentos? Será que resultaria? A Anthropic (mais uma concorrente da OpenAI que ainda não me deu acesso ao seu modelo, o Claude) diz que sim.

Vejamos o que o futuro nos reserva neste campo.

E vocês, o que acham que pode ser feito? Como acham que estes modelos devem ser treinados, com que dados e por quem?

Notícias Várias

Baidu lança o seu concorrente para o ChatGPT

A empresa Baidu, uma espécie de Google Chinês, anunciou o lançamento do seu novo modelo de linguagem de IA, o Ernie Bot, que tem um desempenho particularmente bom em tarefas específicas da cultura chinesa, tais como a explicação de factos históricos e a escrita de poemas tradicionais. No entanto, apesar de ser multimodal (como o GPT-4), o resto do modelo apresenta diversas falhas, deixando alguns clientes iniciais bastante desapontados. Apesar da elevada procura por uma alternativa ao ChatGPT (que é proibido na China), o acesso ao Ernie Bot continua a ser exclusivo para alguns clientes iniciais. A empresa ainda não confirmou se irá disponibilizar a tecnologia à generalidade dos consumidores.

Bard só para para inglês ver

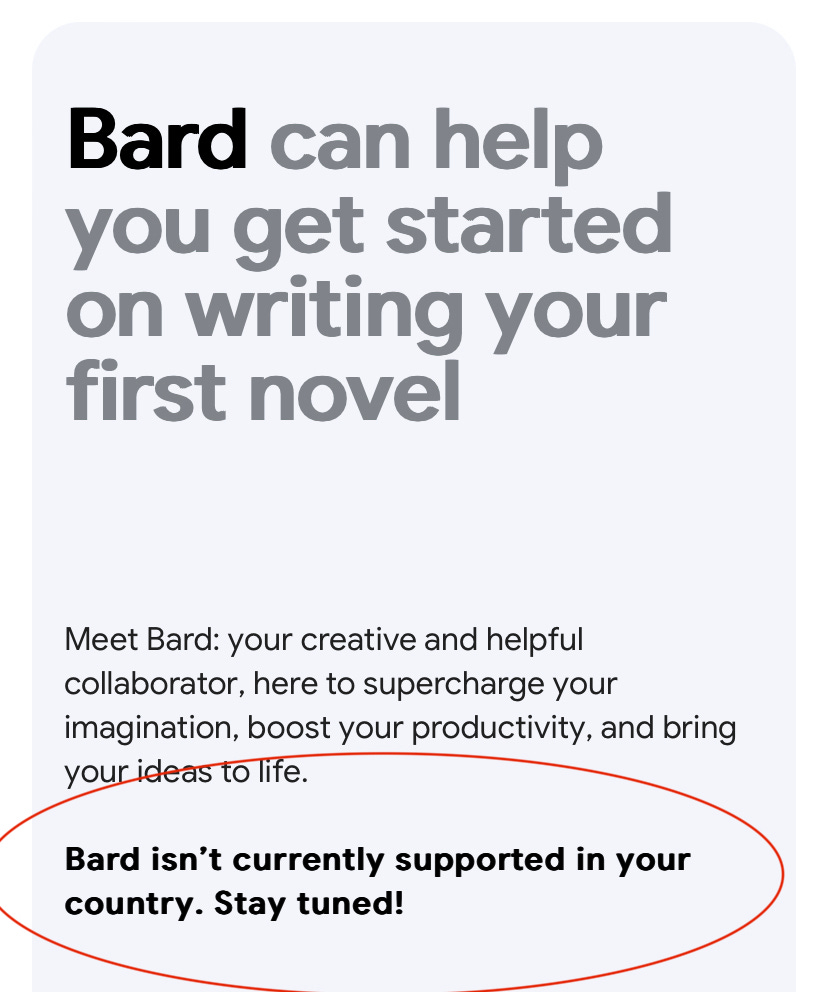

A Google anunciou que o seu concorrente do ChatGPT, o Bard, está agora disponível ao público em geral (mas ainda com uma lista de espera). É claro que eu fui tentar obter acesso para poder fazer uns testes, mas fui recebido com esta bela mensagem:

Esta ideia de que as fronteiras dos países ainda importam na Internet é demasiado antiquada. E com isto, a Google poderá estar a perder o barco neste mercado e, se não tomar medidas mais rapidamente, poderá mesmo sofrer do velho problema do Dilema do Inovador. Um tema para falar numa outra edição da newsletter.

Imprimir comida em 3D

Engenheiros e investigadores da Universidade de Columbia, nos Estados Unidos, estão a utilizar tecnologia laser para imprimir e cozinhar alimentos em 3D, incluindo um cheesecake vegan, que me parece que vem com sabor a inovação. Eu acho mesmo que esta tecnologia pode revolucionar a indústria alimentar porque tem o potencial de criar refeições personalizadas à escala milimétrica. Imaginem como isto pode ser usado para garantir que cada refeição está perfeitamente ajustada às restrições (e gostos) alimentares de cada pessoa. É claro que neste momento o lado negativo é o elevado custo das máquinas e dos lasers, mas naturalmente, essa é a parte em que é mais fácil melhorar, principalmente se estas iniciativas ganharem escala.

Imprimir um rocket em 3D

E por falar em impressão 3D, esta semana foi lançado um rocket que foi 85% feito numa (gigantesca) impressora 3D. A empresa Relativity Space está a apostar nesta tecnologia como uma forma de produzir rockets mais baratos e estruturalmente mais seguros, por terem menos partes onde o rocket se pode desmembrar aquando dos exigentes lançamentos para o espaço. Infelizmente, o rocket não conseguiu chegar à órbita da Terra, mas o problema foi do motor e não da parte impressa. Portanto, há um grande potencial nesta tecnologia, e é mais um passo para democratizar o negócio da exploração espacial.

O Governo Chinês Casamenteiro

Para os cidadãos Chineses da província de Guixi na China Oriental que estavam cansados de usar aplicações de “dating” sem encontrar potenciais combinações, o Governo Chinês decidiu testar o lançamento de um “serviço de encontros” patrocinado pelo Estado. A app "Palm Guixi" utiliza dados (a “vantagem” de se viver numa sociedade autoritária onde não há privacidade social) para construir uma plataforma casamenteira com encontros às cegas incluídos. Este programa faz parte de uma iniciativa a nível provincial para aumentar a taxa de casamento e, naturalmente, a taxa de natalidade decrescente da China.

Falar com filósofos do antigamente

Uma das coisas interessantes destes LLMs que vão aparecendo é a possibilidade de os por a emular o comportamento de pessoas que já não estão entre nós mas que deixaram muito do seu conhecimento em obras escritas. É o exemplo deste site, Ask Seneca, que permite fazer perguntas a um bot que tenta fazer passar-se pelo antigo filósofo Seneca. Para quem se interessa pela filosofia do estoicismo, este é um exercício interessante.

Para quem quer falar com filósofos de verdade e que existem no mundo atualmente, podem sempre começar por falar com a Joana Rita, uma auto-intitulada “perguntóloga”.

Recomendações de leituras

The New York Times - GPT-4 Is Exciting and Scary

Do mesmo jornalista que sofreu bastante ao conversar com o Bing Chat, vem agora o relato dos testes profundos que ele fez com o GPT-4 e como isso o deixou, ao mesmo tempo, esperançoso e receoso pelo futuro. Ele fala também da iniciativa da própria OpenAI em explorar os limites do que o GPT-4 consegue fazer e que foram relatadas num documento cuja leitura é algo assustadora.

(versão sem paywall pode ser lida aqui)

Nota final

Este vídeo é qualquer coisa de extraordinário (e não é CGI):

Até à próxima!

António Lopes